2024 年 5 月,DreamTech 官宣了其高质量 3D 生成大模型 Direct3D,并公开了相关学术论文 Direct3D: Scalable Image-to-3D Generation via 3D Latent Diffusion Transformer。

2024 年 5 月,DreamTech 公司宣布推出了一款名为 Direct3D 的高质量 3D 生成大模型。该模型利用了一种名为 3D Latent Diffusion Transformer 的技术,能够将图像转化为逼真的 3D 模型。同时,DreamTech 还发布了一篇学术论文,详细介绍了 Direct3D 的工作原理和应用场景。

这是首个公开发布的原生三维生成路线的 3D 大模型,通过采用 3D Diffusion Transformer (3D-DiT),解决了长期以来困扰行业的高质量三维内容生成难题。

坚持原生 3D 技术路线并取得重大突破

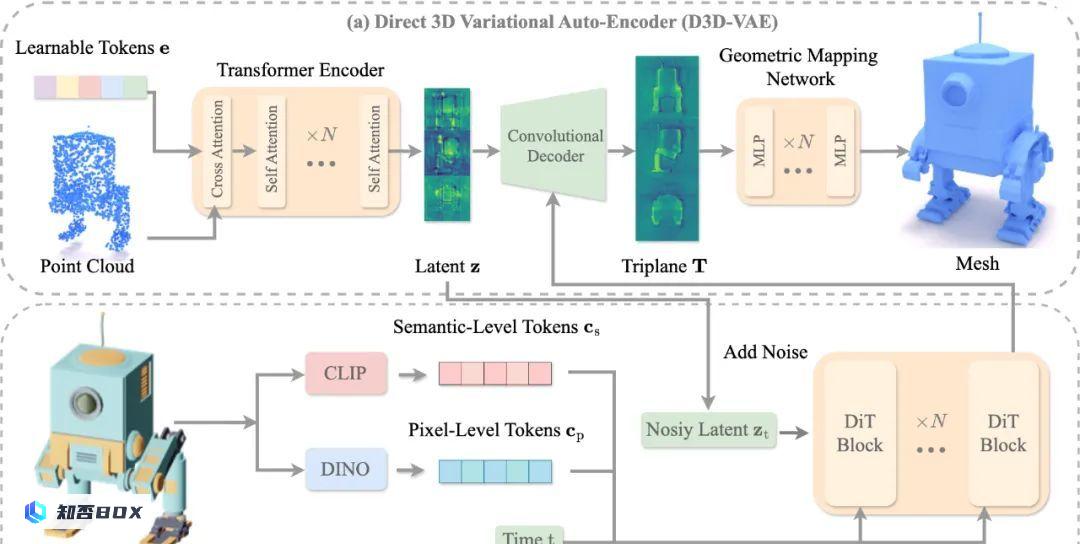

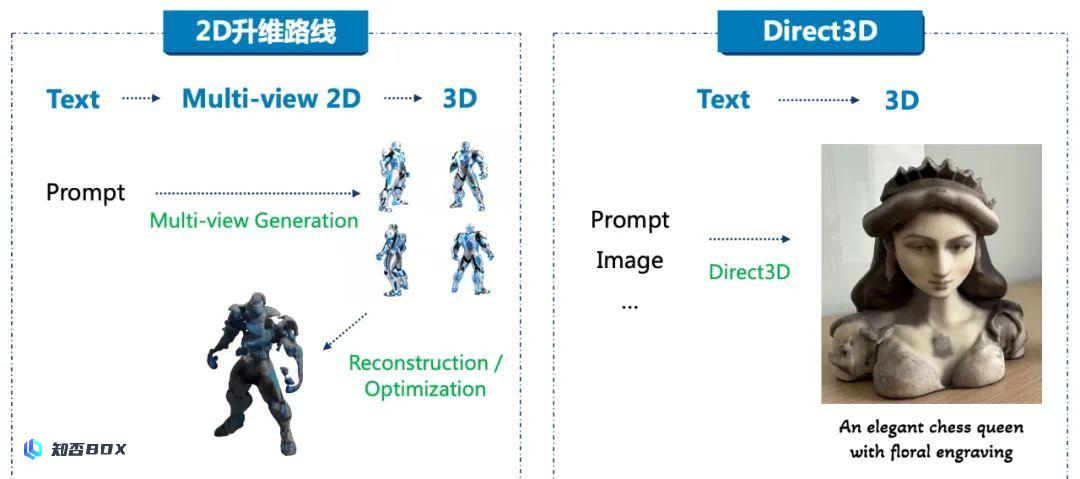

此前,3D AIGC 通常采用的技术路线是将2D图像模型升维得到3D模型,即2D-to-3D lifting。代表性方案包括早期由Google公司提出的DreamFusion,以及由Adobe公司提出的Instant3D。虽然3D数据被逐步引入模型训练过程以提升质量,但是2D升维技术存在一些固有问题,例如多头多面、空腔、遮挡等。现有的解决方案难以满足商业应用对通用三维生成的要求。

去年初,业内部分人员开始尝试原生 3D 路线,即不经过中间的多视角 2D 图片或者多视角迭代优化直接获得 3D 模型,这条技术路线可以避开 2D 升维的缺陷,展现了获取高质量、无畸形、无残缺、可商用 3D 内容的潜力。原生 3D 路线在原理上相较 2D 升维方法具有显著的优势,然而,其模型训练及算法开发一直存在诸多挑战,其中最关键的问题有:

去年初,业内部分人员开始尝试原生 3D 路线,即不经过中间的多视角 2D 图片或者多视角迭代优化直接获得 3D 模型,这条技术路线可以避开 2D 升维的缺陷,展现了获取高质量、无畸形、无残缺、可商用 3D 内容的潜力。原生 3D 路线在原理上相较 2D 升维方法具有显著的优势,然而,其模型训练及算法开发一直存在诸多挑战,其中最关键的问题有:

高效的 3D 模型表征:图像和视频可以直接通过 2D/2.5D 的矩阵表征压缩获得 latent feature,相比之下, 3D 数据拓扑复杂、表征维度更高。如何对三维数据进行高效压缩,进而对 3D latent space 进行三维数据分布的分析与学习,是一直困扰行业人员的难题。

高效的三维模型表征:图像和视频可以通过2D/2.5D的矩阵表征压缩来获得潜在特征,但与此相比,三维数据的拓扑结构更为复杂,表征的维度也更高。如何高效地对三维数据进行压缩,从而对三维潜在空间进行分析和学习,一直是困扰行业人员的难题。

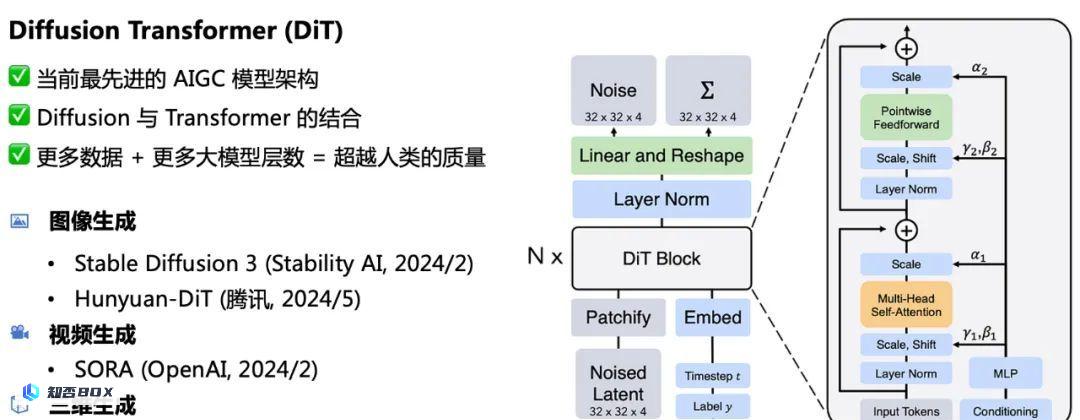

高效的 3D 训练架构: DiT(Diversity in Transformers)架构最先应用在图像生成领域并取得了巨大成功,包括 Stable Diffusion3 (SD3)、Hunyuan-DiT 都采用了 DiT 架构;在视频生成领域,OpenAI SORA 采用 DiT 架构成功实现远超 Runway 和 Pika 的视频生成效果;而在 3D 生成领域,受限于复杂拓扑与三维表征方法,原始的 DiT 架构无法直接应用于 3D mesh 生成。

高质量大规模 3D 训练数据: 3D 训练数据的质量和规模直接决定了生成模型的质量及泛化能力,行业内普遍认为至少需要千万规模的高质量 3D 训练数据才可以达到 3D 大模型的训练要求。然而 3D 数据在全世界范围内都极其缺乏,尽管有诸如 ObjaverseXL 这样千万规模级别的 3D 训练数据集,但其中绝大多数都是低质量的简单结构,可用的高质量 3D 数据占比不足 5%。如何获得足够数量的高质量的 3D 数据是一个世界性的难题。

针对以上核心难题,DreamTech 提出了全球首个原生 3D-DiT 大模型 Direct3D。通过广泛的实验验证,Direct3D 的三维模型生成质量显著超越了目前主流的 2D 升维方法,这主要得益于以下三点:

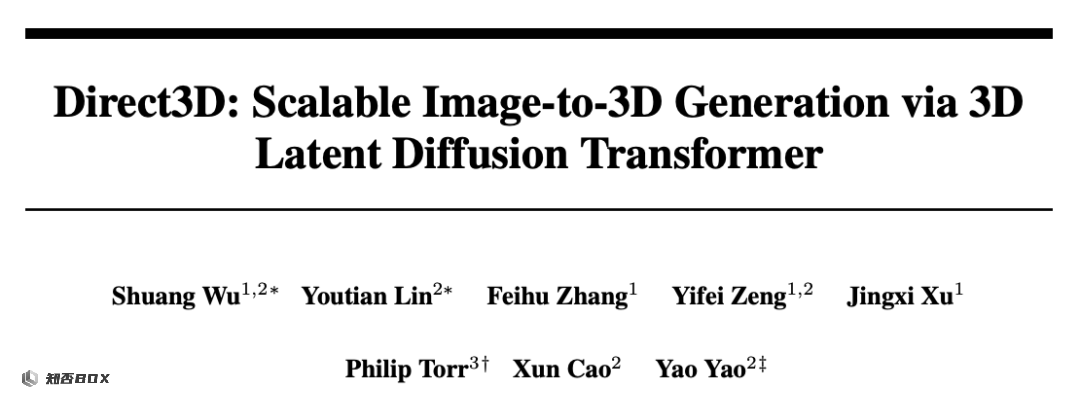

1. 利用原生 3D-DiT 技术,Direct3D 可以更准确地生成三维模型,提高了模型的真实感和细节表现能力。 2. Direct3D 的大模型生成能力非常强大,可以处理更复杂和庞大的模型,满足了现实世界中对于大规模模型的需求。 3. 与传统的 2D 升维方法相比,Direct3D 在模型生成质量上有明显的优势,能够更好地保留原始模型的形状和纹理信息。D3D-VAE: Direct3D 提出了类似 OpenAI SORA 的 3D VAE (Variational Auto-Encoder) 来提取 3D 数据的潜在特征,将 3D 数据的表征复杂度从原本的 N^3 降低到了 n^2 (n<<N) 的紧凑 3D 潜在空间,并通过解码器网络实现了对原始 3D 网格近乎无损的恢复。通过使用 3D 潜在特征,Direct3D 将原本训练 3D-DiT 的计算和内存需求量降低了超过两个数量级,使得大规模 3D-DiT 模型训练成为了可能。

D3D-DiT: Direct3D 采用了 DiT(Deep Image Transformer)架构并对原始 DiT 进行了改进优化,引入了针对输入图像的语义级与像素级对齐模块,可实现输出模型与任意输入图像的高度对齐。

DreamTech 3D 数据引擎: Direct3D 在训练中使用了大量高质量 3D 数据,这些数据绝大部分由 DreamTech 自研的数据合成引擎制作而成。DreamTech 合成引擎建立了数据清洗、标注等全自动数据处理流程,已积累生产了超过 2000 万的高质量 3D 数据,补全了原生 3D 算法落地的最后一块拼图。值得一提的是,OpenAI 在 2023 年 Shap-E 和 Point-E 的训练过程中尝试使用了百万规模的 3D 合成数据,而对比 OpenAI 的数据合成方案,DreamTech 合成的 3D 数据规模更大,且质量更高。

采用分布式互联网技术(DiT)架构

在3D领域中再次验证了Scaling Law

在技术架构方面,Direct3D采用了与OpenAI SORA类似的Diffusion Transformer(DiT)架构。DiT架构是目前最先进的AIGC大模型架构之一,它结合了Diffusion和Transformer两种架构的优势,满足了可扩展性的要求。也就是说,它能够为模型提供更多的数据量和更多的大模型参数量。DiT架构的生成质量甚至可以超越人类的水平。目前,DiT技术已经在多个实践项目中得到应用,包括图像生成方向上的Stable Diffusion 3(Stablility AI,2024年2月)、Hunyuan-DiT(腾讯,2024年5月),以及视频生成方向上的SORA(OpenAI,2024年2月)。而DreamTech的Direct3D则是全球首个公开的3D内容生成方向上的DiT实践。

DiT(分布式信息技术)架构符合并多次验证了Scaling Law(扩展定律)。

在大语言模型上,Scaling Law 已经充分证明了其有效性。随着参数量和训练数据的增加,大模型的智能程度将极大提高。在图像生成领域上,从SD1的参数量0.8B增加到SD3的8B,以及Dall-E 3的参数量12B,都展示了Scaling Law的有效性。在视频生成领域,SORA相比Runway、Pika等,据推测其技术实现上主要是将模型架构换成了DiT,并且在模型参数量与训练数据上都提升了一个数量级。这展示了令人震惊的生成效果,无论是视频分辨率、视频时长还是视频生成质量都得到了极大提升。

3D 领域也是如此,Direct3D-1B 向行业展示了首个可行的原生 3D-DiT 架构,利用自研的高质量数据合成引擎,增加训练数据量及增大模型参数量,生成结果稳步提升,未来 3D 生成领域将由 Direct3D (或其衍生架构) 完全取代现有的 LRM 或 SDS 方案。目前,DreamTech 团队正在稳步推进 Direct3D 的 scale up,计划年底前推出 15B 参数的 Direct3D-XL,同时将训练模型的高质量 3D 数据增加 5 倍以上,3D 生成届时将迎来里程碑时刻。

3D 内容生成质量达到商用级别,具备高度逼真的效果

随着 Direct3D 的推出,3D 生成领域大步跨越进入了商用时代。以 3D 打印为例,使用 Subdivision Surface (SDS)、Layered Rapid Manufacturing (LRM) 等技术方案生成的模型都会存在如下问题:

模型的几何结构可能会出现扭曲,导致出现多个头部和尾部。

模型存在很多尖锐的毛刺,需要进行修整和平滑处理;

表面过度平滑,缺少细节;

表面过于光滑,没有足够的细节呈现;网格的面片数量较少,无法保证细节结构的精确性。

这些问题的存在导致此前各类方案生成的模型无法在3D打印机中正常打印,还需要人工进行调整修补。Direct3D采用原生3D技术路线,训练集中仅使用3D数据,其生成的3D模型质量更接近原始质量,完美解决了几何结构、模型精度、表面细节、mesh面片数量等核心问题。Direct3D生成的模型质量已经超出了家用打印机的精度上限,只有更高规格的商用及工业打印机才能充分还原所生成模型的精细度。

在过去,SDS、LRM等技术方案受限于3D模型特征表达形式,通常生成的模型的面片数量在5-20万之间,而且很难再进一步提高。然而,在商业应用中,3D模型的面片数量通常需要达到100-500万以上。为了满足各种商业场景的需求,Direct3D提出了更精细的3D特征表达范式,使得所生成的模型的面片数量没有上限,可以达到甚至超过1000万。

随着 Direct3D 模型参数量及训练数据量的增加,3D 生成技术可以应用到的行业会越来越广泛,包括万亿级别的游戏、动漫行业。预计在2025年底之前,3D 生成技术将逐渐取代大部分游戏、动画、影视建模的工作,成为各行业大规模使用的主要工具。

Direct3D 实践经验

基于 Direct3D 大模型,DreamTech 推出了两款尝鲜产品,目前已经开放申请测试(点击阅读原文,跳转:www.neural4d.com)。

其一是面向 C 端用户的 Animeit!,Animeit! 可以将用户输入的任意图片或文字对象转换为二次元风格的高质量 3D 人物形象。这些 3D 人物具备骨骼节点,可以用于动作绑定。在 Animeit! 上,用户可以与个性化的 3D AI 伙伴直接对话并进行动作交互。

Animeit! 所生成的二次元角色精细度极高,脸部轮廓细节清晰可辨,手部细节凸显、手指粒粒分明,这是此前的 3D 生成技术路线无法达到的质量水平,已可用于二次元社区 MMD 制作。

Animeit! 所生成的二次元角色具有非常高的精细度,脸部轮廓的细节非常清晰,可以清楚地辨认出来。手部的细节也非常突出,手指之间的纹理非常清晰,每个细小的粒子都能够分辨出来。这种质量水平是之前的3D生成技术无法达到的,现在已经可以应用于二次元社区的MMD制作中。另一款产品则为面向创作者的 3D 内容创作平台,用户可以像使用Midjourney这类平台一样,通过文本描述在 1 分钟之内获得高质量的 3D 模型,无需等待长时间的优化和改进;用户也可以仅上传单张图片,稍作等待即可获得高质量且还原精准的 3D 模型。

关于 DreamTech

DreamTech 在 3D AI 技术领域进行深入研究和开发,旨在通过创新的产品和服务提升全球 AIGC 创作者和消费者的使用体验。公司的愿景是利用先进的 AI 技术,实现与真实世界的无缝对接和实时互动的 4D 时空体验,并通过模拟真实世界的复杂性和多样性来实现通用人工智能 (AGI)。

DreamTech 汇集了全球顶尖的人工智能(AI)人才,其创始团队由英国两院院士、国家级青年人才以及多位深圳市高层次人才组成。公司的核心成员毕业于牛津大学、香港中文大学、香港科技大学等世界知名学府,并曾在苹果、腾讯、百度等行业领先企业任职。创始团队成员曾成功创立多家在3D领域成为标杆的公司,这些公司后来被苹果、谷歌、博世等业界巨头收购。