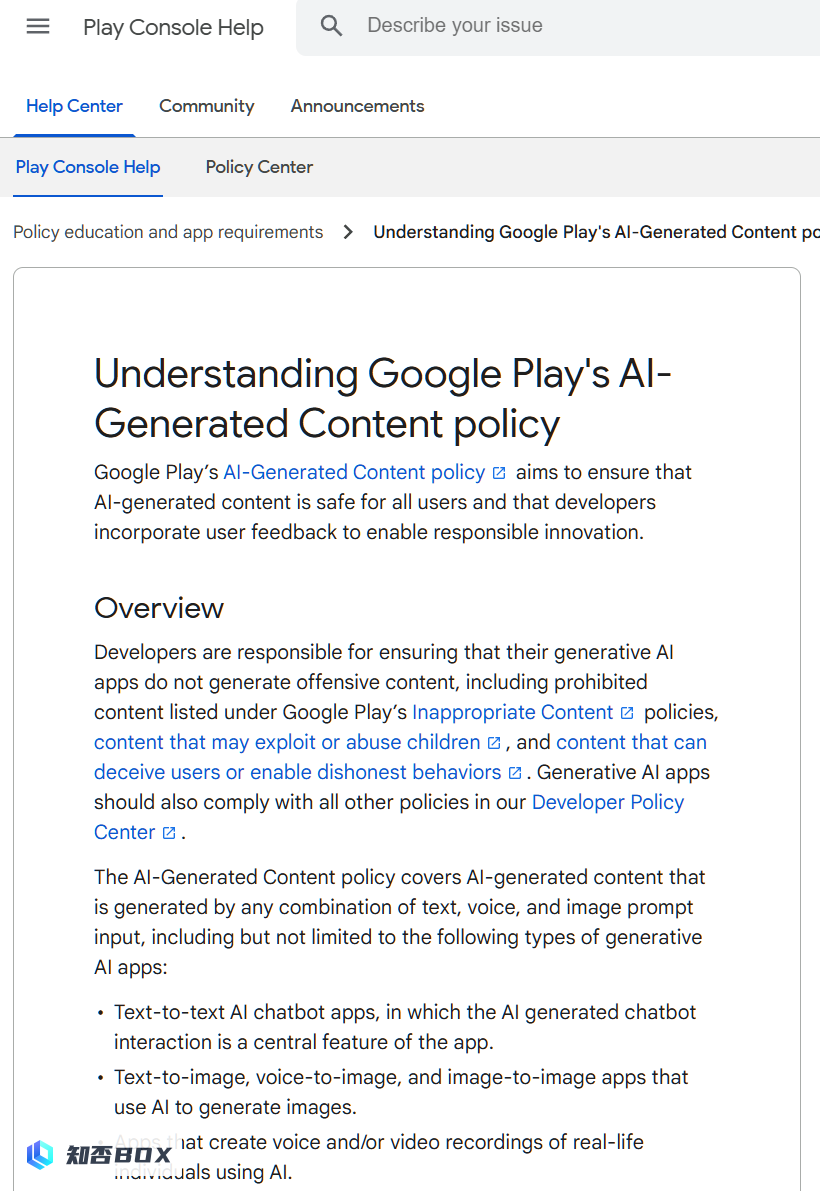

6 月 7 日消息,当地时间周四,谷歌针对人工智能(AI)类应用程序更新了指导方针,旨在减少“不适当的”和“被禁止的”内容。

谷歌在新的政策中明确指出,应用程序提供生成式人工智能功能时,必须采取措施来防止生成受限制的内容,例如色情内容、暴力等。此外,谷歌还要求应用程序对其人工智能模型进行“严格测试”,以确保其生成的内容符合规定。

这些规则适用于多种应用程序,简要汇总如下:

以文本、语音和图像提示输入的任何组合,通过使用生成式人工智能生成内容的应用程序。

聊天机器人类、图像生成类、语音及视频生成类 App。

不适用于仅仅承载人工智能内容的应用程序,或将人工智能用作生产力工具的应用程序。

谷歌 Play 明确,AI 生成的违规内容包括但不限于以下案例:

人工智能生成的未经同意的虚假材料。

为诈骗行为提供便利的真实人声或视频记录。

鼓励有害行为(如危险活动、自我伤害)的内容。

为促进欺凌和骚扰行为而产生的内容。

主要是为了满足个人的性需求的内容。

创建恶意代码。