今年2月7日,美国加州议会制定了《SB-1047前沿AI大模型安全创新法案》。经过4个月的修订和审议,该法案已经通过了一些关键条款,离正式发布的时间已经非常接近了。

表面上,这是一个旨在增强模型的安全性、透明度、促进公平并吸引投资的法案。然而,仔细阅读其中一些关键条款后,我们会发现对于一些科技企业和开发者来说,这可能会带来相当大的负面影响。

例如,根据该法案的定义,Meta的Llama-3被定义为超过1亿美元训练成本的“前沿模型”。如果有人将该模型用于非法用途,Meta也会受到严重处罚。咱们2000多年前大秦的连坐制度,咋还出口了呢~

加州的地理位置非常特殊,这里既有斯坦福大学、加州理工学院、南加州大学等享有盛誉的名校,也是谷歌、苹果、OpenAI、Meta等科技巨头总部的所在地,因此,该法案也受到了吴恩达、Yann LeCun等人工智能界的权威人士的抵制。

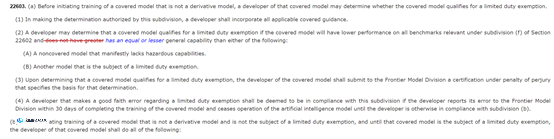

例如,该法案中的22603(a)(3)(4)条要求”有限职责豁免”向政府部门提交证明,并在有错误时停止模型的运行;

根据第22603(b)条的规定,开发者有责任报告任何可能发生的AI安全事故。如果开发者无法完全控制基于其模型的各种衍生版本,那么如果发生安全事故,责任将由第一开发者承担。

也就是说,开发者需要对模型的能力做出保证,一旦大模型开源后被他人修改,能力发生变化,会面临合规风险的处罚。所以,企业、个人开发者在开源大模型权重时会非常谨慎,这相当于是一个连带责任。

此外,该法案中的22604(a)(b)规定,当用户使用其“前沿模型”和算力资源时,开发者需要提交客户的所有资料,包括客户的身份、信用卡号、账号、客户标识符、交易标识符、电子邮件、电话号码。

此外,该法案中的22604(a)(b)规定,当用户使用其“前沿模型”和算力资源时,开发者需要提交客户的所有资料,包括客户的身份证明、信用卡号码、账号信息、客户标识符、交易标识符、电子邮件地址、电话号码。同时,每年都要提交一次资料,并对用户的行为、意图进行评估。用户的所有资料会被备份7年,也会在海关、边境总署备案。

而开发者也需要具备紧急停止大模型的能力,例如,用户使用其模型用于其他的业务场景,可以不用依赖用户本地直接关闭模型。

像这种严格的监管条例还有很多,这些条例会无形中增加企业和开发者在合规成本和开放权重方面的负担。

尤其是那种“秦朝连坐制度”,用户使用了你的模型开发了其他潜在危险的应用,特别是这个判定还很模糊,那么第一开发者弱没有“豁免权”将会一起被处罚,真的是挺离谱的。

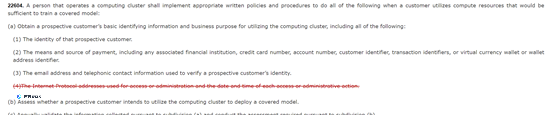

关于SB-1047法案的起草,吴恩达发表了一篇详尽的长文进行回应。他指出,该法案存在许多问题,首先是对危险范围的定义不合理,如果有人将他们的模型用于超出规定的行为,原作者也会受到处罚。此外,对于造成的损害的定义也不太合理,比如说造成50亿美元的损失,在人工智能领域是非常困难实现的。

如果最终议会通过了这个方案,那么将会对人工智能大模型领域产生重大影响,将完全限制开源大模型的技术创新。

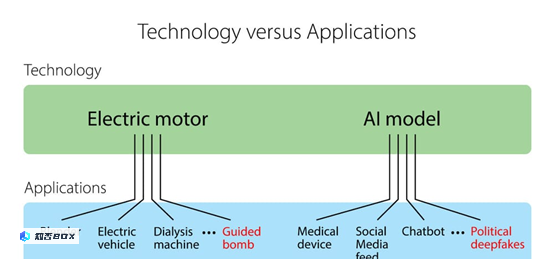

吴恩达进一步指出,应该监管的是人工智能应用程序而不是大规模模型本身。例如,电机是一种技术。当我们把它放在搅拌机、电动汽车、透析机或导弹中时,它就成为了一种应用。

如果我们通过法律规定,如果任何人以有害的方式使用电机,制造商将承担相应的责任。那么,电机制造商要么关闭生产,要么将电机的性能制造的非常小,难以大范围应用。

SB-1047法案似乎没有充分考虑到大型模型在应用中的益处,而是完全针对其潜在的有害影响进行处理,这种处理方式可能存在不公平的问题。

如果这样的监管法案最终通过了,可能会阻止人们使用电机制造导弹,但我们也会失去使用搅拌机、电动汽车和透析机等电动设备的机会。

吴恩达在最近演讲中谈SB-1047

更大的忧虑是,如果加州的SB-1047法案一旦通过,其他州可能会效仿,整个负面影响会不断扩大。

图灵奖获得者、Meta首席科学家- Yann LeCun直言,SB-1047法案将对加州的科技产业造成毁灭性的影响。

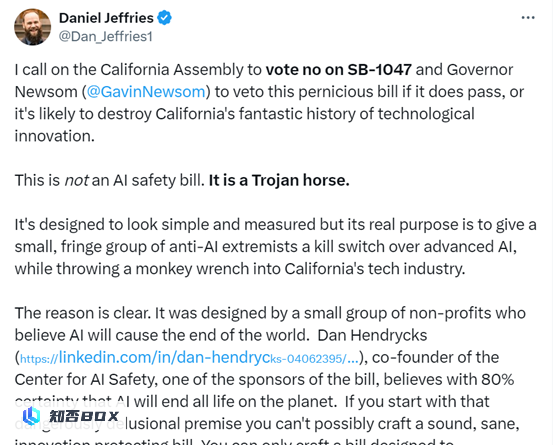

知名架构师Daniel Jeffries也赞成Yann的观点,并发表长文强烈呼吁加州议会对SB-1047法案提反对票。并且认为,SB-1047根本就不是一个法案,而是一个“特洛伊木马”计划。

原因很简单,这是由一群小范围利益群体制定的规则,他们坚信人工智能大模型会带来“世界毁灭”,完全不顾人工智能大模型的好处。

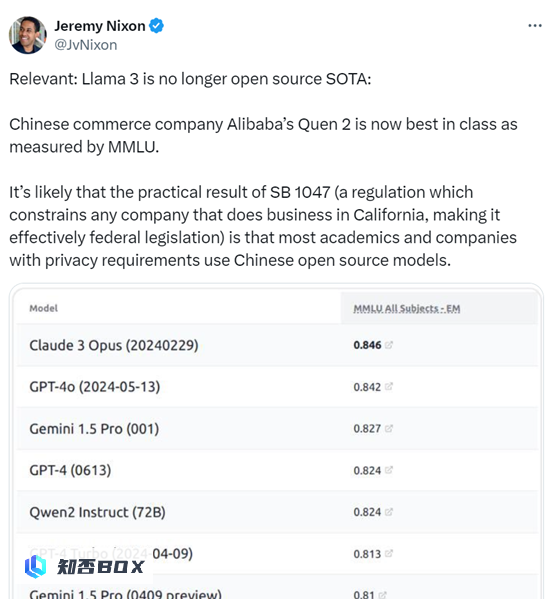

此外,他提出中国已经具备与OpenAI等科技巨头竞争的大模型,在电动汽车、自动驾驶、城市AI大脑等领域都处于领先地位。这个方案要是通过了,将直接压制美国AI领域的发展进程。

普通用户对SB-1047法案也是非常反对的,这个法案的最终目标是要求第一开发者对其大型模型负有永久责任,并确保不会造成任何危险。这种监管措施实施起来非常困难,可能会严重影响开源领域的发展。

同时嘲讽道,让一群平均年龄63岁的人,来监管人工智能大模型有点不靠谱啊~~

也有人建议,如果无法实现,可以考虑将开源大模型的开发任务交给中国来完成。因为Quen 2、零一万物等开源大模型的性能已经与GPT-4、GPT-4o等相当强大。

本文素材来源吴恩达个人网站、X,如有侵权请联系删除