今年10月,作为Apple公司与哥伦比亚大学的研究成果,Ferret就已经发布过一次,只是当时仅供研究使用而非商业许可,所以并未引起多大关注。如今情况发生了转变,随着各大科技公司竞相公布研发成果,关于本地模型为小型设备提供智能体验的讨论也越来越多。

近期,苹果公司也陆续公布了它在人工智能领域的研发进展。12月初,苹果发布了专门用于Apple Silicon平台的AI框架MLX,以及一种能够在设备端执行大型语言模型的方法。这种方法可以在边缘设备上执行比DRAM两倍大的模型,从而节省了执行大型模型所需的计算资源,并且更加确保了隐私安全。

最近,苹果发布了最新的成果——Ferret大语言模型以及相关的标杆测试工具和数据集。

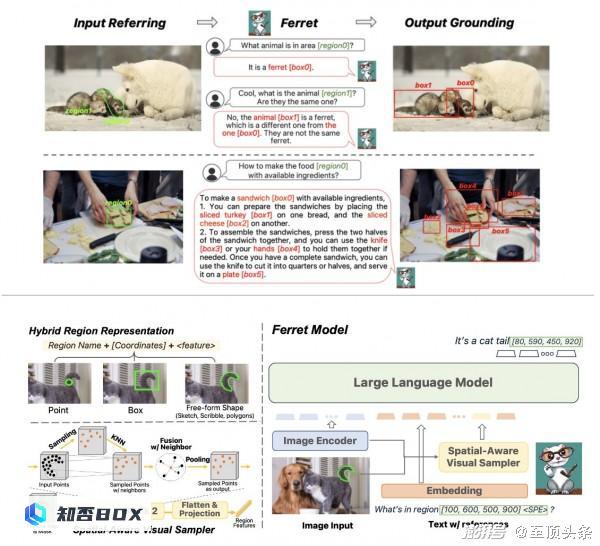

作为一款多模态模型,Ferret可以接受文本、声音、影像或数据的输入。根据苹果10月公布Ferret的研究论文,Ferret能理解任何形状或任何图像颗粒(granularity),并且可以准确地定位开放词汇的描述。为了将引用和定位能力整合到模型中,Ferret采用一种混合区域表征(hybrid region representation)技术,整合个别方位和连续性的特征,以表示图像中的某一区域。为了提取出区域中的连续特征,苹果研究人员提出一种空间感知的视觉采样器,它能处理不同形状和多种稀疏性。这也使Ferret可以接受多样化区域输入,例如点、边界框、自由形式的形状。

与Kosmos-2、GPT4-ROI、LLaVA、Shikra等多模态大语言模型相比,最后苹果得到的模型Ferret-13B在传统引用和定位任务上表现出色。此外,在基于区域、需要本地化的多模态对话、细节描述以及复杂推理等任务中,Ferret-13B的性能也优于其他模型。在视觉化比较任务中,苹果声称其模型展现出优秀的空间理解和常识推理能力。此外,苹果还声称其模型相比Shikra、InstructBLIP、MiniGPT4、LLaVA、MM-GPT和mPLUG-Owl等知名模型,具有更少的物件幻觉。

苹果发布了Ferret7B和130B两个模型的代码、GRIT数据集和标杆测试工具Ferret-Bench。上周还发布了Ferret 70B和130B的检查点。

有趣的是,在AI社区中,很多人都是到最近才发现苹果的巨型模型,Bart de Witte也在X上感叹自己居然错过了这个消息,同时也表示:“期待着有一天,本地巨型语言模型能作为重新设计的iOS的集成服务,运行在我的iPhone上。”

随着苹果的大型模型开发取得新的进展,Anthropic和OpenAI据称正在就其专有大语言模型的开发工作进行新的巨额融资谈判。