AIGC动态欢迎阅读

原标题:Llama 3低比特量化性能

下降显著!全面评估结果来了 | 港大&北航Ð

关键字:权重,性能,方法,数据,模型文章来源:量子位

内容字数:4343字内容摘要:

QHT 投稿量子位 | 公众号 QbitAI大模型力大砖飞,让LLaMA3演绎出了新高度:

超15T Token数据上的超大规模预训练,既实现了令人印象深刻的性能提升,也因远超Chinchilla推荐量再次引爆开源社区讨论。

与此同时,在实际应用层面上,另一个热点话题也浮出水面:

资源有限场景下,LLaMA3的量化表现又会如何?

香港大学、北京航空航天大学、苏黎世联邦理工学院联合推出了一项实证研究,全面揭示了LLaMA3的低比特量化性能。

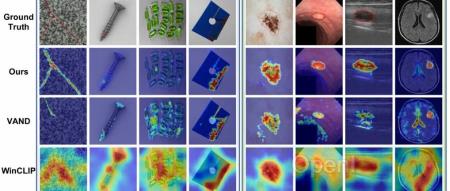

研究人员使用现有的10种训练后量化和LoRA微调方法,评估了LLaMA3在1-8比特和各种评估数据集上的结果。他们发现:

尽管性能令人印象深刻,LLaMA3在低比特量化下仍然遭受了不可忽视的退化,特别是在超低位宽上。

项目已在GitHub上开源,量化模型也已登陆HuggingFace。

具体来看实证结果。

轨道1:训练后量化表1和表2中分别提供了LLaMA3-8B和LLaMA3-70B在8种不同的PTQ方法下的低比特性能表现,覆盖了从1比特到8比特的广泛比特宽度。

1.低比特权重

其中,Round-To-Nearest (RTN) 是一种基本的舍入量原文链接:Llama 3低比特量化性能下降显著!全面评估结果来了 | 港大&北航Ð

联系作者

文章来源:量子位

作者微信:QbitAI

作者简介:追踪人工智能新趋势,关注科技行业新突破